افزایش ترس عمومی از خطرات فعلی هوش مصنوعی

پژوهشی تازه از دانشگاه زوریخ نشان میدهد که ترس عمومی درباره خطرات فعلی هوش مصنوعی، مانند تعصب الگوریتمی و انتشار اطلاعات نادرست، بسیار بیشتر از ترسهای نظری درباره نابودی احتمالی بشریت در آینده است. به گزارش تکناک، این تحقیق شکاف مهمی در دانش موجود را پر میکند. در گفتوگوهای عمومی، اغلب این نگرانی وجود دارد […] نوشته افزایش ترس عمومی از خطرات فعلی هوش مصنوعی اولین بار در تک ناک - اخبار تکنولوژی روز جهان و ایران. پدیدار شد.

پژوهشی تازه از دانشگاه زوریخ نشان میدهد که ترس عمومی درباره خطرات فعلی هوش مصنوعی، مانند تعصب الگوریتمی و انتشار اطلاعات نادرست، بسیار بیشتر از ترسهای نظری درباره نابودی احتمالی بشریت در آینده است.

به گزارش تکناک، این تحقیق شکاف مهمی در دانش موجود را پر میکند. در گفتوگوهای عمومی، اغلب این نگرانی وجود دارد که تمرکز بر سناریوهای آیندهنگر و مهیج باعث نادیده گرفتن مشکلات فعلی شود. اما این نخستین مطالعهای است که دادههایی نظاممند ارائه میدهد و نشان میدهد که آگاهی از تهدیدهای واقعی کنونی حتی در مواجهه با هشدارهای آخرالزمانی نیز پابرجاست

با وجود آنکه پیشرفتهای مداوم در زمینه هوش مصنوعی واکنش فوری سیاستگذاران را ضروری کردهاست، تلاشهای اخیر برای مقایسه این فناوری با اثرات ناگهانی و شدید شلیک تسلیحات هستهای، بر پایه قیاسی سادهانگارانه است که به دوران جنگ سرد بازمیگردد و تحولات بعدی در درک تهدیدهای هستهای را نادیده میگیرد. به جای قیاس با جنگ هستهای سراسری، شیوهای سودمندتر برای درک هوش مصنوعی، بررسی آن بهمثابه اختلالی در سامانههای جهانی است که بیشتر با زنجیرههای پیچیده و نامطمئن زمستان هستهای شباهت دارد.

در یک سال و نیم گذشته، اخبار جنجالی به افزایش هیاهو درباره قابلیتهای حیرتانگیز هوش مصنوعی دامن زدهاند. اما در حالیکه مفسران عمومی خود را برای ظهور اربابان ماشینی آماده میکنند، بیخردی مصنوعی در حال آغاز زنجیرهای از اختلالات گسترده اجتماعی است. انتشار اطلاعات نادرست با کمک هوش مصنوعی، بیاعتمادی را گسترش میدهد، الگوریتمهای رسانههای اجتماعی قطبیسازی را تشدید میکنند و تولید انبوه محتوای جعلی مشارکت دموکراتیک را تحلیل میبرد و احساس مشترک ما از واقعیت را از بین میبرد.

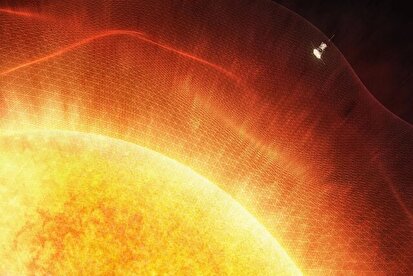

محصولات کنونی هوش مصنوعی گرمایش زمین و کمبود منابع را تشدید میکنند؛ از استخراج مواد معدنی برای سختافزارها گرفته تا مصرف برق و آب فراوان. اما در بیانیههای تهدید هوش مصنوعی، کمتر به آثار زیستمحیطی آن اشاره میشود. افزون بر این، همین سیستمها میتوانند برای اهداف شرورانه استفاده شوند؛ مانند تولید سموم جدید یا آموزش ساخت بمب.

حتی اگر این کاربردها هنوز به ورودی انسانی نیاز داشته باشند، شواهدی وجود دارد که نشان میدهد هوش مصنوعی در حال شناسایی اهداف در غزه است و مسابقه برای توسعه سلاحهای خودکار مرگبار آغاز شده است.

بر اساس این مطالعه که توسط تیمی از دانشمندان علوم سیاسی انجام شده، اکثر افراد میان سناریوهای فرضی آیندهنگر و مشکلات ملموس کنونی تمایز قائل میشوند و تهدیدهای واقعی و جاری را جدیتر تلقی میکنند. این تحقیق که با مشارکت بیش از ۱۰ هزار نفر از ایالات متحده و بریتانیا در قالب سه آزمایش گسترده آنلاین انجام شد، واکنش شرکتکنندگان به تیترهای خبری درباره خطرات گوناگون هوش مصنوعی را بررسی کرد.

برخی از افراد در معرض اخبار مرتبط با تهدیدهای فاجعهبار و وجودی هوش مصنوعی قرار گرفتند، گروهی دیگر درباره خطرات فعلی مانند تبعیض و اطلاعات نادرست مطالعه کردند و تعدادی نیز با مزایای این فناوری آشنا شدند. هدف پژوهشگران، بررسی این مسئله بود که آیا هشدارهای آخرالزمانی باعث کاهش حساسیت نسبت به چالشهای واقعی و فعلی میشود یا خیر.

به گفته پروفسور فابریتزیو جیلاردی از دانشکده علوم سیاسی دانشگاه زوریخ، «یافتههای ما نشان میدهد که شرکتکنندگان بهطور قابل توجهی بیشتر نگران خطرات فعلی ناشی از هوش مصنوعی هستند تا تهدیدهای احتمالی آینده». او تأکید کرد که حتی اگر مطالبی درباره تهدیدهای وجودی باعث افزایش ترس از آن نوع خطرات شود، نگرانی درباره پیامدهای کنونی مانند تبعیض سیستماتیک در تصمیمگیریهای هوش مصنوعی و از دست رفتن فرصتهای شغلی همچنان در اولویت باقی میماند.

این مطالعه نخستین تحقیق نظاممند در نوع خود است که با دادههای تجربی نشان میدهد بحث درباره خطرات بلندمدت هوش مصنوعی لزوماً توجه به چالشهای واقعی امروز را تضعیف نمیکند. به گفته اما هوس، یکی دیگر از نویسندگان پژوهش، «نتایج ما نشان میدهد که گفتوگو درباره ریسکهای بلندمدت، لزوماً به قیمت نادیده گرفتن مسائل فعلی تمام نمیشود».

پژوهشگران این مطالعه با تأکید بر ضرورت یک رویکرد جامع، خواستار برقراری گفتوگویی فراگیر درباره طیف کامل خطرات هوش مصنوعی شدند. جیلاردی در پایان افزود: «گفتمان عمومی نباید دوگانه باشد. باید بهطور همزمان، هم چالشهای فعلی و هم تهدیدهای بلندمدت را درک و مورد توجه قرار دهیم».

نوشته افزایش ترس عمومی از خطرات فعلی هوش مصنوعی اولین بار در تک ناک - اخبار تکنولوژی روز جهان و ایران. پدیدار شد.

واکنش شما چیست؟