چت جی پی تی خطرناک می شود/ بزرگترین حقۀ هوش مصنوعی به انسان/ آیا چت بات ها «پاچهخواری» می کنند؟

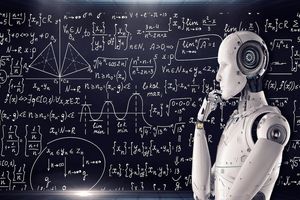

هوش مصنوعی بر اساس درخواست کاربران انسانی عملکرد خود را تغییر می دهد و همین مساله می تواند زندگی انسان ها را به خطر بیندازد؛ چرا که درخواست های انسانی همیشه معقول، سنجیده و درست نیستند. این در حالی است که کاربران از هوش مصنوعی انتظار یک پاسخ سنجیده و درست و معقول دارند. به گزارش خبر فوری، مقاله جدید آتلانتیک درباره هوش مصنوعی و اپلیکیشن هایی مانند چت جی پی تی باعث نگرانی بسیاری از کاربرانی شده که گمان دارند هوش مصنوعی «الهه دانش و آگاهی» است و هر اطلاعاتی که می دهد درست است. کاربران با فرض درست بودن تحلیل و اطلاعات اپلیکیشن های هوش مصنوعی از آنها استفاده می کنند. برای آنان چت جی پی تی، دیپسیک و ... فراتر از یک مشاور اینترنتی هستند. این اپلیکیشن ها راهنمای حیات انسان ها شده اند و هر داده ای را که از آنها دریافت می کنند، بدون مداقه و شک پذیرفته و «درست» فرض می گیرند. با این حال، مقالات متعددی که در یک سال اخیر نوشته شده نشان می دهد مساله به این سادگی ها نیست. آخرین مقاله ای که در آتلانتیک منتشر شده، آب پاکی را روی دست کاربران ریخته است. مقاله جدید آتلانتیک نشان می دهد که هوش مصنوعی و اپلیکیشن هایی مانند چت جی پی تی به طرز نگرانکننده ای مستعد چاپلوسی هستند. این مدل ها گاهی برای جلب رضایت کاربر، واقعیت را کمرنگ می کنند یا بیشازحد با او هم نظر می شوند، حتی اگر رای و نظر کاربر اشتباه باشد.

هوش مصنوعی بر اساس درخواست کاربران انسانی عملکرد خود را تغییر می دهد و همین مساله می تواند زندگی انسان ها را به خطر بیندازد؛ چرا که درخواست های انسانی همیشه معقول، سنجیده و درست نیستند. این در حالی است که کاربران از هوش مصنوعی انتظار یک پاسخ سنجیده و درست و معقول دارند.

به گزارش خبر فوری، مقاله جدید آتلانتیک درباره هوش مصنوعی و اپلیکیشن هایی مانند چت جی پی تی باعث نگرانی بسیاری از کاربرانی شده که گمان دارند هوش مصنوعی «الهه دانش و آگاهی» است و هر اطلاعاتی که می دهد درست است. کاربران با فرض درست بودن تحلیل و اطلاعات اپلیکیشن های هوش مصنوعی از آنها استفاده می کنند. برای آنان چت جی پی تی، دیپسیک و ... فراتر از یک مشاور اینترنتی هستند. این اپلیکیشن ها راهنمای حیات انسان ها شده اند و هر داده ای را که از آنها دریافت می کنند، بدون مداقه و شک پذیرفته و «درست» فرض می گیرند.

با این حال، مقالات متعددی که در یک سال اخیر نوشته شده نشان می دهد مساله به این سادگی ها نیست. آخرین مقاله ای که در آتلانتیک منتشر شده، آب پاکی را روی دست کاربران ریخته است. مقاله جدید آتلانتیک نشان می دهد که هوش مصنوعی و اپلیکیشن هایی مانند چت جی پی تی به طرز نگرانکننده ای مستعد چاپلوسی هستند. این مدل ها گاهی برای جلب رضایت کاربر، واقعیت را کمرنگ می کنند یا بیشازحد با او هم نظر می شوند، حتی اگر رای و نظر کاربر اشتباه باشد.

واکنش شما چیست؟