انویدیا با همکاری دانشگاه MIT هوش مصنوعی SANA را منتشر کرد

مدل هوش مصنوعی جدید انویدیا به نام SANA میتواند تصاویر با کیفیت 4K و وضوح ۴۰۹۶ در ۴۰۹۶ پیکسل را در چند ثانیه تولید کند. محققان انویدیا و دانشگاه MIT و «دانشگاه چینهوا» مدل هوش مصنوعی جدیدی به نام Sana معرفی کردهاند که میتواند تصاویری با کیفیت عالی و هماهنگی قوی بین متن و تصویر […] نوشته انویدیا با همکاری دانشگاه MIT هوش مصنوعی SANA را منتشر کرد اولین بار در تک ناک. پدیدار شد.

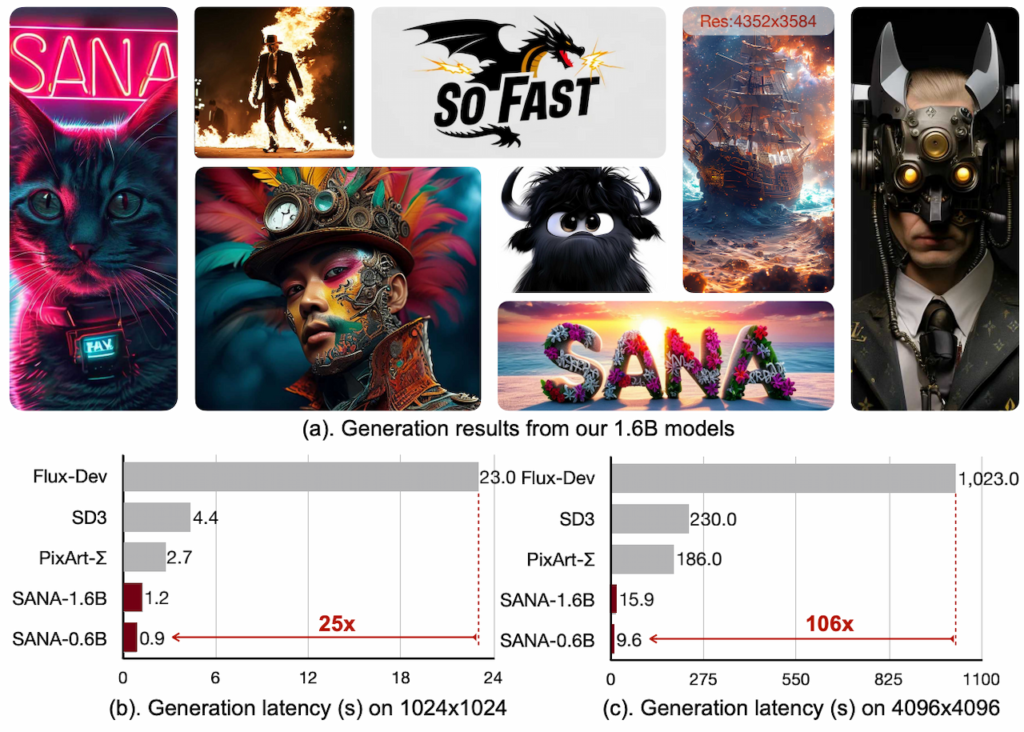

مدل هوش مصنوعی جدید انویدیا به نام SANA میتواند تصاویر با کیفیت 4K و وضوح ۴۰۹۶ در ۴۰۹۶ پیکسل را در چند ثانیه تولید کند.

محققان انویدیا و دانشگاه MIT و «دانشگاه چینهوا» مدل هوش مصنوعی جدیدی به نام Sana معرفی کردهاند که میتواند تصاویری با کیفیت عالی و هماهنگی قوی بین متن و تصویر را با سرعت بسیار زیاد تولید کند.

nvlabs مینویسد که ویژگیهای اصلی طراحی این مدل شامل فشردهسازی عمیق خودرمزگذار، استفاده از DiT خطی، کدگذاری متن با مدل کوچک فقط رمزگشا و بهینهسازی در مراحل آموزش و نمونهگیری است. Sana بهعنوان راهکاری برای تولید محتوای تصویری باکیفیت و هزینه ارزان، ابزار مهمی برای طراحان و محققان ارائه میدهد.

ویژگیهای اصلی طراحی Sana

۱. فشردهسازی عمیق خودرمزگذار (Deep Compression Autoencoder)

این فناوری با نام DC-AE، برخلاف خودرمزگذارهای سنتی که فشردهسازی را تا ۸ برابر انجام میدهند، مقیاس فشردهسازی را تا ۳۲ برابر افزایش داده است. خودرمزگذار DC-AE با فشردهسازی تصویر بهگونهای طراحی شده است که تعداد توکنهای نهفته (Latent Tokens) را ۱۶ برابر کاهش میدهد و در نتیجه، آموزش و تولید تصاویر با وضوح چشمگیر، همچون وضوح 4K، بهبود یافته است.

۲. DiT خطی کارآمد

در این چهارچوب، DiT خطی جایگزین توجهات معمولی (Vanilla Attention) شده است و پیچیدگی محاسباتی را از مرتبه O(N²) به O(N) کاهش میدهد. DiT خطی با Mix-FFN همراه است که به کمک کانولوشنهای عمقی ۳ در ۳ در MLP، اطلاعات محلی توکنها را تقویت میکند. این روش بدون نیاز به کدگذاری موقعیت (NoPE) کیفیت تصویر را حفظ و زمان پردازش برای تولید تصاویر 4K را ۱/۷ برابر سریعتر میکند.

۳. کدکننده متن با مدل کوچک فقط رمزگشا

هوش مصنوعی Sana از مدل Gemma بهعنوان کدکننده متن استفاده میکند که برخلاف مدلهایی نظیر CLIP و T5، درک بهتری از متن و دستورها را ارائه میدهد. بهمنظور بهبود هماهنگی متن و تصویر، از طراحی دستورالعملهای پیچیده انسانی (CHI) در Gemma بهره گرفته شده و با استفاده از یادگیری در بافت، توانایی هماهنگی متن و تصویر افزایش یافته است.

۴. راهبردهای بهینه آموزش و استنتاج

هوش مصنوعی Sana با ارائه راهکارهایی مانند Flow-DPM-Solver، مراحل نمونهگیری را از ۲۸-۵۰ به ۱۴-۲۰ مرحله کاهش میدهد و عملکرد بهتری را درمقایسهبا روشهای سنتی مانند Flow-Euler-Solver به ارمغان میآورد. در این فرایند، چندین مدل VLM توضیحات متنوعی تولید میکنند و با استراتژی مبتنیبر امتیاز CLIP (CLIPScore)، توضیحاتی با امتیاز بیشتر انتخاب میشود تا همگرایی و هماهنگی متن و تصویر بهبود یابد.

برتریهای عملکرد Sana درمقایسهبا مدلهای پیشرفته

آزمایشها نشان میدهد که هوش مصنوعی Sana-0.6B درمقایسهبا مدلهای بزرگتر مانند Flux-12B با وجود اندازه بسیار کوچکتر (۲۰ برابر)، تا بیش از ۱۰۰ برابر سریعتر عمل میکند. این مدل حتی روی یک GPU لپتاپ با حافظه ۱۶ گیگابایت به خوبی کار میکند و میتواند تصاویر با وضوح ۱۰۲۴ در ۱۰۲۴ را در کمتر از ۱ ثانیه تولید کند. Sana-0.6B با مدلهایی مانند PixArt-Σ که اندازه مشابهی دارند، تا ۵ برابر سریعتر است و در معیارهای FID، امتیاز CLIPو GenEval و DPG-Bench نیز بهطرز چشمگیری برتری دارد.

درمقایسهبا مدلهای پیشرفتهای مانند FLUX-dev و Sana-0.6B عملکردی رقابتی ارائه میدهد. برای مثال، در معیارهای DPG-Bench، این مدل دقتی معادل و در GenEval اندکی کمتر دارد؛ اما با بهرهوری درخورتوجه، Sana-0.6B در طول گذر ۳۹ برابر و Sana-1.6B نیز ۲۳ برابر سریعتر است.

این چهارچوب جدید نهتنها سرعت زیادی دارد؛ بلکه به تولید محتوای تصویری باکیفیت و هزینه کمتر کمک میکند و در آینده میتواند بهعنوان ابزاری مؤثر برای طراحان محتوا و محققان و توسعهدهندگان بهکار گرفته شود.

نوشته انویدیا با همکاری دانشگاه MIT هوش مصنوعی SANA را منتشر کرد اولین بار در تک ناک. پدیدار شد.

واکنش شما چیست؟