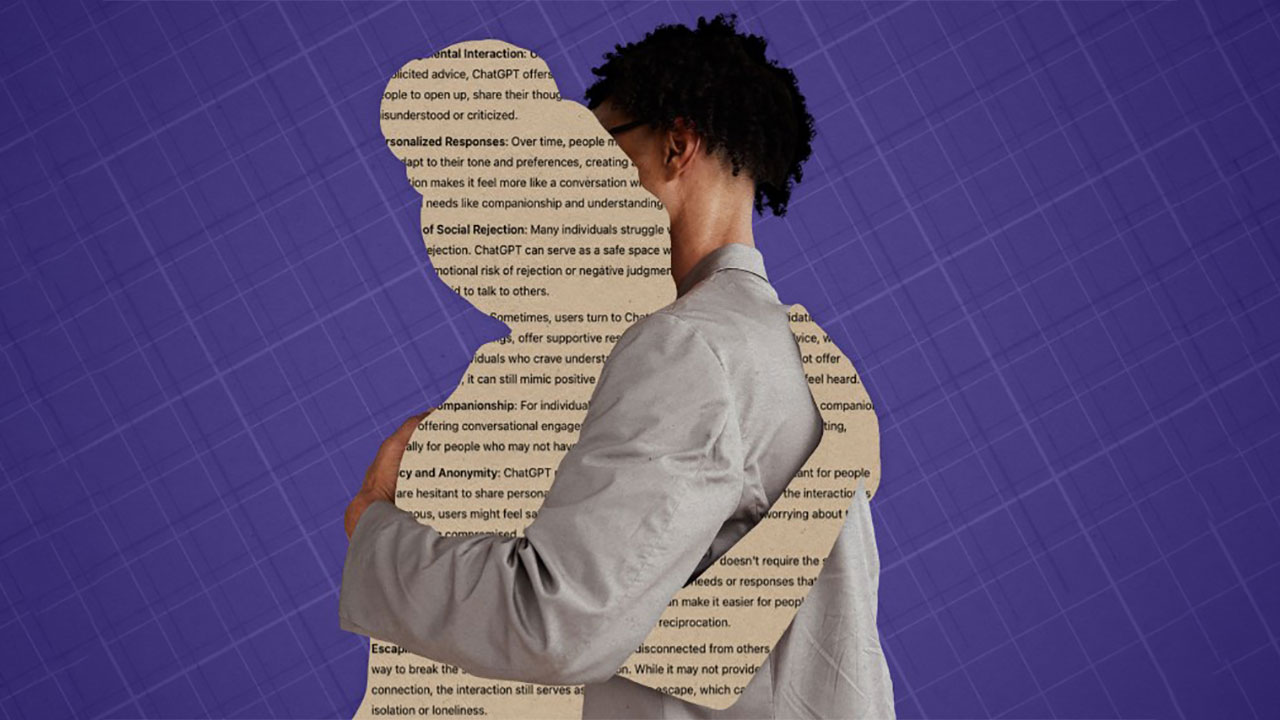

استفاده بیش از حد از ChatGPT ممکن است وابستگی احساسی ایجاد کند!

شرکت OpenAI به طور مداوم مدلهای جدید هوش مصنوعی ChatGPT را معرفی میکند تا عملکرد این چتبات را بهبود بخشیده و تجربهای بهتر برای 400 میلیون کاربر خود فراهم کند. با این حال، به نظر میرسد که دسترسی آسان به این ابزار هوش مصنوعی ممکن است چالشهایی را نیز به همراه داشته باشد و این […]

شرکت OpenAI به طور مداوم مدلهای جدید هوش مصنوعی ChatGPT را معرفی میکند تا عملکرد این چتبات را بهبود بخشیده و تجربهای بهتر برای 400 میلیون کاربر خود فراهم کند. با این حال، به نظر میرسد که دسترسی آسان به این ابزار هوش مصنوعی ممکن است چالشهایی را نیز به همراه داشته باشد و این سؤال را مطرح کند که آیا استفاده بیش از حد از چنین فناوریهایی میتواند پیامدهای ناخواستهای داشته باشد؟ با ما در دیجی رو همراه باشید.

در حال حاضر، این شرکت هوش مصنوعی در حال بررسی پیامدهای روانشناختی استفاده از ChatGPT بر کاربران خود است. OpenAI نتایج یک مطالعه دو قسمتی را منتشر کرده است که با همکاری آزمایشگاه رسانهای MIT انجام شده و ارتباطی میان افزایش استفاده از این چتبات و افزایش احساس تنهایی را نشان داده است.

در این مطالعه، هر دو سازمان به صورت مستقل تحقیقاتی را انجام داده و سپس نتایج آنها در یک نتیجهگیری کلی ادغام کردهاند. در بخش تحقیقات OpenAI، دادههای مربوط به بیش از 40 میلیون تعامل در ChatGPT طی یک ماه بررسی شده است. این بررسی بدون مداخله انسانی انجام شده تا حریم خصوصی کاربران حفظ شود. در مقابل، MIT حدود 1000 شرکت کننده را که به مدت 28 روز از ChatGPT استفاده کردهاند، مورد مطالعه قرار داده است. در حال حاضر، این تحقیقات هنوز تحت بررسی علمی و داوری همتا قرار نگرفتهاند.

مطالعه MIT به بررسی جنبههای مختلف تعامل با چتبات پرداخته که میتوانند بر تجربه احساسی کاربران تأثیر بگذارند، از جمله استفاده از متن یا صوت. نتایج این پژوهش نشان داد که هر دو روش ارتباطی پتانسیل ایجاد احساس تنهایی را دارند و همچنین میتوانند بر نحوه اجتماعی شدن کاربران در مدت زمان مطالعه تأثیر بگذارند. همچنین، لحن صوتی و موضوع مکالمات نیز به عنوان عوامل مؤثر شناسایی شدند.

تحلیل دادهها نشان داد که استفاده از لحن خنثی در حالت صوتی چتبات احتمال بروز واکنشهای احساسی منفی را کاهش میدهد. با این حال، تحقیق نشان داد که افرادی که مکالمات شخصیتری با ChatGPT داشتند، بیشتر احتمال داشت احساس تنهایی کنند؛ اگر چه این اثرات معمولاً کوتاه مدت بودند. جالب اینکه حتی افرادی که از طریق متن با چتبات درباره موضوعات عمومی گفتگو میکردند، نیز وابستگی عاطفی بیشتری به آن پیدا میکردند.

این تحقیق همچنین نشان داد کاربرانی که ChatGPT را به عنوان یک دوست میپنداشتند و کسانی که به طور کلی گرایش به وابستگی احساسی شدید در روابط خود داشتند، بیشتر در معرض احساس تنهایی و وابستگی عاطفی به چتبات بودند. این یافتهها نشان میدهند که هوش مصنوعی ممکن است به طور ناخواسته برای برخی کاربران به یک منبع جایگزین ارتباط انسانی تبدیل شود، به ویژه برای افرادی که از قبل احساس تنهایی داشتهاند.

مطالعه OpenAI نیز زمینههای دیگری را روشن کرد. بر اساس نتایج این مطالعه، تعاملات احساسی با ChatGPT به ندرت اتفاق میافتد. علاوه بر این، حتی در میان کاربرانی که به طور گسترده از ویژگی پیشرفته “حالت صوتی” استفاده میکردند و ChatGPT را به عنوان یک دوست میدیدند، میزان واکنشهای احساسی نسبت به چتبات پایین گزارش شد.

OpenAI هدف از انجام این مطالعات را درک چالشهایی که ممکن است به واسطه فناوریهای آن ایجاد شوند و همچنین تعیین انتظارات و مثالهایی برای استفاده صحیح از مدلهای هوش مصنوعی عنوان کرده است. این شرکت تأکید دارد که توسعه فناوریهای هوش مصنوعی نباید تنها بر قابلیتهای فنی تمرکز کند، بلکه باید تأثیرات اجتماعی و روانشناختی آن نیز مورد بررسی قرار گیرد.

در حالی که OpenAI معتقد است که مطالعه تعاملی آن میتواند رفتارهای انسانی را شبیهسازی کند، بسیاری از کاربران واقعی در پلتفرمهای عمومی مانند Reddit اعتراف کردهاند که از ChatGPT به عنوان جایگزینی برای مراجعه به درمانگر استفاده میکنند. این روند میتواند نگرانیهایی درباره وابستگی بیش از حد به هوش مصنوعی برای حمایت عاطفی و روانی ایجاد کند.

در نهایت، تحقیقات انجام شده حاکی از آن است که در حالی که چتباتهایی مانند ChatGPT میتوانند تعاملات مفیدی ارائه دهند، باید مراقب اثرات جانبی ناخواسته آنها نیز بود. وابستگی بیش از حد به چنین ابزارهایی میتواند باعث کاهش تعاملات انسانی واقعی شود و در بلند مدت پیامدهایی برای سلامت روان کاربران به همراه داشته باشد. بنابراین، لازم است که کاربران با درک صحیح از کارکرد این ابزار، به تعادل در استفاده از آن دست یابند و در مواقع لزوم به تعاملات انسانی واقعی نیز توجه داشته باشند.

واکنش شما چیست؟